Introducción

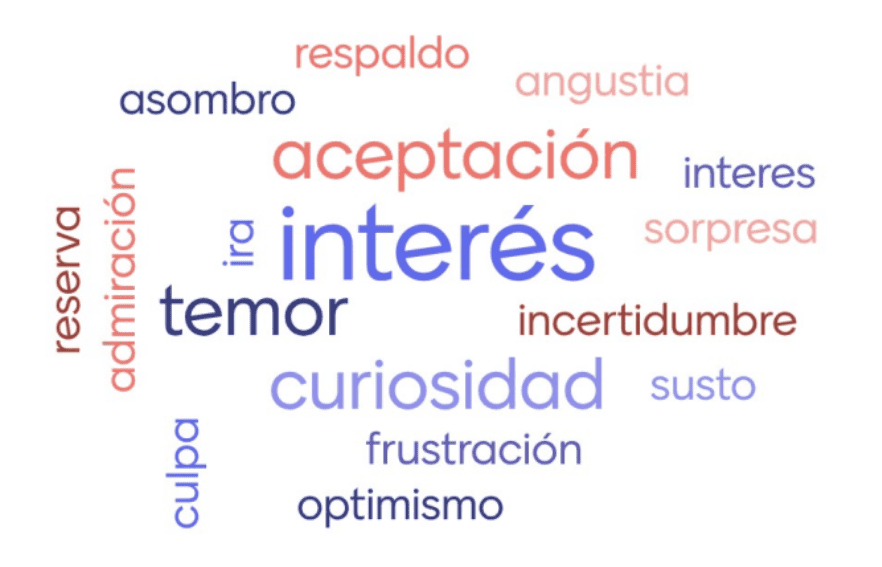

Asombro, interés y curiosidad, pero también temor, culpa e incertidumbre. Estas son algunas emociones que diferentes colegas de la sociedad civil sienten respecto a la Inteligencia Artificial generativa. Así nos lo expresaron en distintos espacios de conversación que facilitamos.

A inicios de 2025, en SocialTIC nos preguntamos cómo está el sector social en América Latina en relación con la Inteligencia Artificial y, más específicamente, con la Inteligencia Artificial Generativa (IAG) —aquella cuyo output o resultado es la creación de contenido—. Con tal de ofrecer formación y recursos educativos apropiados a la sociedad civil latinoamericana, optamos por inicialmente conocer cómo se está usando la IAG en las organizaciones de la sociedad civil en la región, qué ideas y qué necesidades existen al respecto.

Entonces echamos a andar un diagnóstico que tiene dos pilares:

- El primero de ellos es un sondeo virtual, mismo que aún se encuentra abierto. Si participas en el sector social en América Latina. te invitamos a participar. Responder toma unos 10 minutos y podrás solicitar que te avisemos cuando se publiquen recursos y talleres: Formulario Usos y necesidades de herramientas de Inteligencia Artificial en organizaciones de la sociedad civil en América Latina

- El segundo pilar se compone de talleres participativos que, a través del diálogo colectivo en espacios físicos y virtuales, facilitamos conversaciones en donde se intercambian percepciones, retos, miedos, información sustentada y recomendaciones para el aprovechamiento de la IAG desde visiones críticas y sociales.

En este post queremos compartirte nuestros principales aprendizajes hasta el momento y también invitarte a conversar. Si te interesa que facilitemos un taller participativo en tu organización o colectiva, apúntate en nuestro formulario de registro de solicitud a taller participativo sobre Inteligencia Artificial Generativa para OSC.

Aquí resumimos ocho de nuestros hallazgos, mismos que detallamos en el resto de este post:

- ChatGPT es la herramienta más usada, al grado que se llega a utilizar como sinónimo de “inteligencia artificial”.

- La IAG se usa principalmente para la redacción de texto.

- Ya existe una adopción de herramientas de IAG en la sociedad civil, rara vez fomentada o acompañada por las organizaciones.

- El uso de IAG en OSC se ha intensificado entre 2024 y 2025.

- Existen nociones y emociones ambivalentes respecto a la IA.

- Tendencia mayoritariamente favorable a la adopción.

- Preocupaciones sobre la privacidad son la principal barrera de adopción.

- Existe necesidad no es solo de acompañamiento técnico y práctico sino también de conversación y reflexión crítica.

Hallazgos clave

El sondeo en línea ha circulado entre contrapartes, colectivas y organizaciones que avanzan y defienden los derechos humanos. Si bien la mayoría son de organizaciones mexicanas, también hemos conocido respuestas de Argentina, Brasil, Chile, Colombia, Costa Rica, Ecuador, Guatemala y Perú.

Los espacios de conversación de los talleres participativos han sido fructíferos. En lo que va del año hemos realizado nueve grupos focales virtuales con personas de distintas organizaciones, causas, roles de trabajo y países, además de otros tres espacios al interior de algunas organizaciones mexicanas.

El sondeo en conjunto con los espacios de conversación nos han permitido cosechar algunos aprendizajes.

Herramientas y tipos de uso

La herramienta más usada, por amplia diferencia, es ChatGPT. El resto tuvieron apenas un par de menciones o, incluso, una sola. Esto coincide con las tendencias de uso generales, en las que también lidera ChatGPT. Cabe mencionar que surgieron también herramientas que, aunque en su origen no lo contemplaban, han incorporado funcionalidades basadas en IAG, por ejemplo Canva, Metricool o Atlas.ti. Otras herramientas mencionadas son NotebookLM, Deepseek, Gemini, Humata, Google Translate, Deepl, Appscaler, Read AI y Narakeet.

A grandes rasgos, los tipos de uso que suelen dársele a la IA entre las personas participantes se podrían clasificar en cuatro categorías: redacción de texto, investigación, creación multimedia y gestión de tareas. Si bien no todos los usos se ciñen estrictamente a la IAG, la mayoría sí entran en este rubro.

El principal uso que se le da a la IAG es la asistencia en redacción de textos. Nos parece interesante que este hallazgo coincide con el presentado en el artículo How People Use ChatGPT, publicado por OpenAI, según el cual la escritura es, por mucho, con un 40%, el principal uso de ChatGPT relacionado con el trabajo.

En la categoría redacción de textos incluímos usos en al menos tres momentos del proceso de escritura: ideación, ejecución y revisión.

- En la ideación se usa como un colega que te sugiere ideas o con quien las platicas: “me sirve para romper la hoja el blanco”, “es como para ‘pelotear’ ideas”, nos dijeron algunas personas participantes. El resultado de este tipo de uso suele ser el esquema de un texto o sugerencias de posibles abordajes sobre un mismo tema.

- En la ejecución se emplea para que arroje propuestas de texto que —ya sea tras algún ajuste o directamente— podrían ser usadas, por ejemplo, para responder correos electrónicos o para publicaciones en redes sociodigitales. También se registró el uso de IAG para redactar textos de mayor complejidad, como reportes, propuestas de postulación de fondos o documentos jurídicos.

- Mientras que en la revisión se le suele dar un texto para que revise su ortografía, gramática e incluso el tono.

La traducción —un uso que también fue reportado con frecuencia— sería un proceso distinto pero, en última instancia, también ligado a la redacción de texto.

Respecto a los usos de IA para investigación —la segunda categoría más común—, encontramos la obtención, consulta, análisis y procesamiento de información. Algunos ejemplos que nos compartieron fueron social listening, sistematización de sentencias jurídicas, transcripción de audios, síntesis de documentos, generación de scripts para visualizar mapas y la asistencia en análisis de datos, tanto cualitativos como cuantitativos. A este respecto, en Escuela de Datos documentamos cómo organizaciones de sociedad civil utilizan ChatGPT para procesar y visualizar datos.

En el terreno de lo multimedia, aparecieron usos para crear diapositivas, para editar o retocar imágenes o, directamente, para crear imágenes y videos que luego fueron publicados en redes sociodigitales. Al respecto, tuvimos reflexiones sobre la conveniencia de usar contenido multimedia sintético —aquél generado por IA— debido a que, en algunos contextos, este suele asociarse a la desinformación. Sin embargo, también hubo experiencias en las cuales, gracias al uso de estas herramientas, equipos pequeños solventaron labores de comunicación que de otro modo probablemente no hubieran podido.

Por último, con muy pocas menciones, aparecieron usos que pertenecen más a la gestión de tareas en las organizaciones, tales como la toma automatizada de notas en reuniones virtuales o la automatización de tareas, específicamente para facturación.

Si bien varía entre organizaciones, en términos generales notamos que ya existe un uso de herramientas de IAG, proveniente sobre todo de iniciativas a nivel individual y muy pocas veces fomentado o acompañado por la organización. Asimismo, en la mayoría de los casos donde hay uso, este inició o se intensificó durante en 2025. Vale la pena mencionar que hay un grupo, minoritario, que se niega a adoptar dicha tecnología por diversas preocupaciones, que mencionaremos más adelante.

Barreras y actitudes

La forma en que concebimos y cómo nos sentimos en relación con la IA puede influir en la forma de aproximarnos a dicha tecnología. Así que también preguntamos sobre ello. Encontramos nociones y emociones ambivalentes respecto a la IA.

Respecto a las nociones o términos asociados a la IA, hubo tres categorías:

- ideas neutras vinculadas con lo técnico: algoritmos, computadoras, matemáticas, muchos datos, automatización, tecnología, robots, tecnología, herramienta;

- elementos positivos: oportunidad, innovación, aprendizaje, ayuda a humanos, apoyo, conveniencia, futuro

- elementos negativos: plagio, dominación, contaminación, desplazamiento de trabajo, sumisión.

En términos emocionales, también existe una cierta ambivalencia que incluye interés, asombro, curiosidad y aceptación, mientras que, por el otro, hay temor, culpa, aversión e incertidumbre.

Sin embargo, y como ya mencionamos previamente, esta ambivalencia no ha sido obstáculo para el uso y experimentación de dicha tecnología que, en general, es vista como oportunidad de agilizar trabajo y reducir cargas.

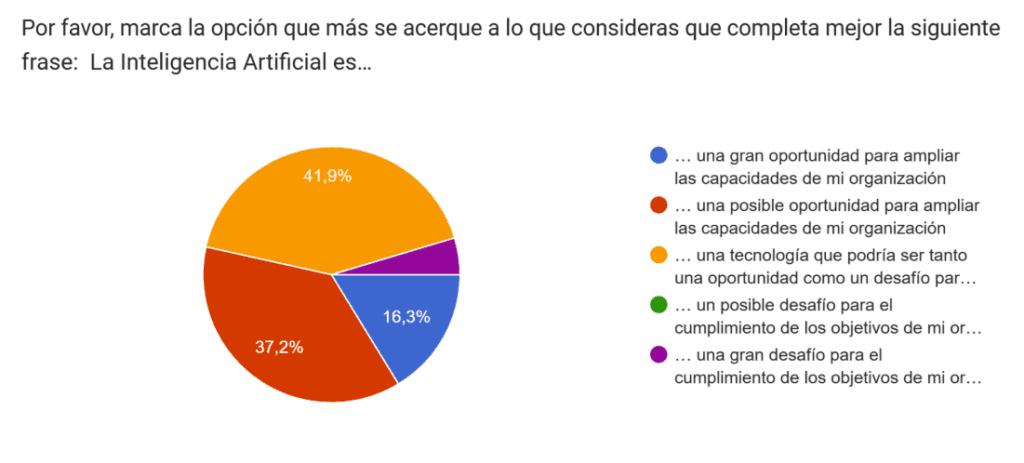

Asimismo, observamos una tendencia mayoritariamente favorable a la adopción de la IA. En el sondeo, un 53 % respondieron que la IA es una posible o una gran oportunidad para ampliar las capacidades de su organización. Un 42 % consideraron que podría ser tanto una oportunidad como un desafío. Solo un 5 % la situaron como un gran desafío para el cumplimiento de los objetivos de su organización.

Por otro lado, las principales barreras declaradas para la adopción en el uso de IA declaradas en nuestro sondeo fueron:

- Preocupación por las vulneraciones a la privacidad

- Falta de conocimiento y capacidades para identificar el uso y elección de una herramienta

- Preocupación por los impactos sociales y ambientales

En los grupos de enfoque la poca claridad sobre el uso y privacidad de los datos otorgados a estas herramientas también fue barrera de adopción preponderante. “Manejamos información muy sensible de víctimas que acompañamos y, como no sabemos exactamente qué pasa con la información que compartimos con estas herramientas, pues mejor no las usamos”, nos dijo una colega.

Respecto a los impactos sociales y ambientales, notamos preocupaciones relacionadas con la cantidad de agua y energía asociadas al funcionamiento de herramientas de IAG. Aunque pocas, también hubo voces que señalaron los dilemas ético-políticos de utilizar herramientas cuyos dueños tejen alianzas con grupos antiderechos o brindan servicios para la milicia y la vigilancia, así como una preocupación por la posible pérdida de empleos o de capacidades cognitivas. En pocos casos estas preocupaciones se han traducido en la decisión de no usar IAG, en otros tantos, sí se usan las herramientas, pero con culpa.

En atención a lo anterior, desde SocialTIC proponemos un enfoque de uso y también una serie de recursos con los que buscamos fomentar un uso informado y responsable. Buscamos pasar de las barreras a las oportunidades sin dejar de lado la aproximación crítica. El enfoque de uso lo presentamos en el siguiente apartado y los recursos están enlazados al final del texto.

Hacia un uso estratégico, responsable, transparente y documentado

Cuando preguntamos a colegas qué necesitan en relación con la IA, tuvimos respuestas como “reflexionar conscientemente” o “conocer las herramientas para poder elegir”. Fue patente una necesidad de espacios de formación, pero también de comunidad. Es decir, identificamos la necesidad de acompañamiento en las habilidades instrumentales y aspectos técnicos, pero también de espacios para conversar y reflexionar sobre las implicaciones y conveniencia de adoptar IAG.

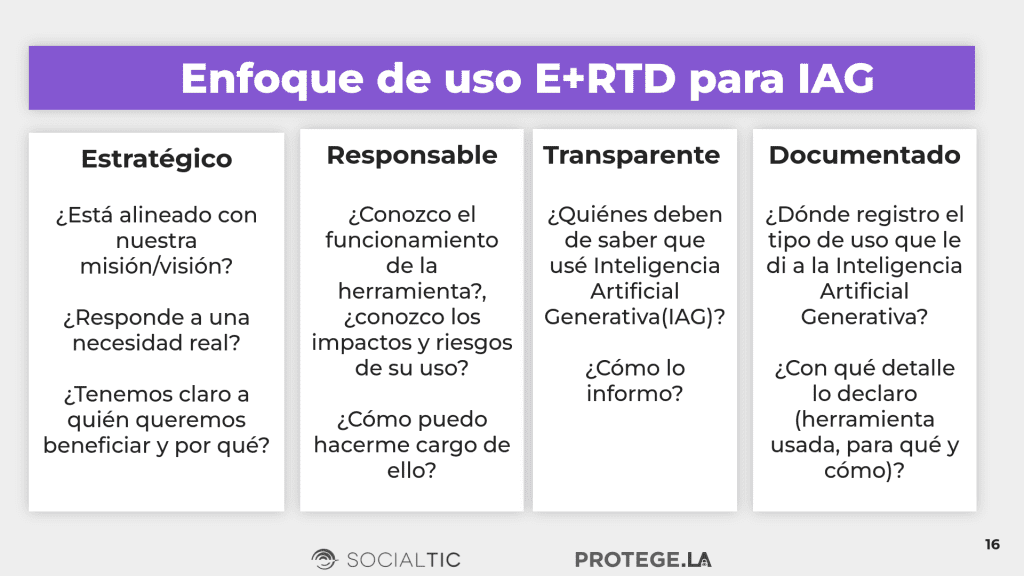

El aspecto que despertó mayor interés para futuras conversaciones fue el de propuestas para un uso responsable, seguido de cerca por usos y aplicaciones prácticas. Frente a estas preocupaciones, desde Social TIC nos ha resonado el enfoque RTD, propuesto por la investigadora Mariana Ferrarelli en el documento Inteligencia Artificial y Educación: Insumos para su Abordaje desde Iberoamérica, publicado por la OEI. Dicho enfoque propone establecer políticas institucionales orientadas al uso Responsable, Transparente y Documentado de IAG.

Aunque está pensado para la educación, consideramos que el enfoque tiene potencial para otros ámbitos, como el de las OSC. Por ello, lo adaptamos añadiéndole un elemento más que consideramos clave para el sector social: el estratégico. Buscamos con ello hacer una pausa y evitar la adopción irreflexiva de una tecnología solo para “no quedarse atrás” o subirse a una tendencia “inevitable”, sino procurar que sea porque obedece a nuestra misión y nos acerca a los objetivos que perseguimos. Queda entonces la propuesta E+RTD: estratégico, responsable, transparente y documentado.

Es una propuesta en construcción, que por ahora se traduce en algunas preguntas que podemos hacernos frente al uso de IAG:

Este enfoque no pretende ser normativo, sino responder a algunas necesidades identificadas en el diagnóstico. Así, con esto queremos ofrecer una serie de preguntas que nos ayuden como OSC a reflexionar de qué manera y con qué objetivos incorporar, o no, IAG en nuestros equipos y flujos de trabajo. En todo caso, a partir de estas preguntas, podrían irse generando pautas e incluso políticas de uso de este tipo de herramientas al interior de las OSC.

Esta reflexión está apenas en sus inicios. Aquí compartimos ya algunos aprendizajes que hemos cosechado, pero sabemos que tanto el interés como el temor —y todo lo que hay en medio— son mejores de atravesar en colectivo. Por ello, desde lo técnico hasta lo reflexivo, aquí estamos para conversar y acompañar. Si te interesa que facilitemos un taller participativo en tu organización, o armar un espacio colectivo sobre IA, llena nuestro formulario de registro de solicitud a taller participativo sobre IAG para OSC.

Referencias y recursos relacionados

- Ferrarelli, Mariana (2024). Inteligencia artificial y educación: insumos para su abordaje desde Iberoamérica. OEI. https://oei.int/wp-content/uploads/2024/12/libro-inteligencia-artificial-y-educacion-insumos-para-su-abordaje-desde-iberoamerica.pdf

- Horowitz, Andreessen. (2025). The Top 100 Gen AI Consumer Apps – 5th Edition https://a16z.com/100-gen-ai-apps-5/

- Chatterji, A., Cunningham, T., Deming, D. J., Hitzig, Z., Ong, C., Yan Shan, C. y Wadman, K. (2025). How People Use ChatGPT. [Working paper] http://doi.org/10.3386/w34255